Tem uma teoria que, quanto mais eu observo o comportamento da internet nos últimos anos, mais difícil fica ignorar: talvez a internet, como espaço orgânico de interação humana, já não exista da forma como imaginamos.

A chamada Dead Internet Theory parte de uma hipótese desconfortável. A ideia de que, em algum momento da última década, a maior parte da atividade online deixou de ser produzida por pessoas interagindo com pessoas e passou a ser dominada por bots, automações e sistemas de geração de conteúdo.

A internet sempre teve bots. Então qual é o ponto?

Bots sempre existiram. Spam sempre existiu. Manipulação digital sempre existiu. O que muda agora é a escala.

Perfis que postam 24 horas por dia. Comentários que parecem humanos, mas soam ligeiramente genéricos. Tendências que surgem simultaneamente em múltiplas plataformas. Discussões inflamadas que parecem espontâneas, mas seguem roteiros previsíveis.

A teoria sugere algo mais radical do que “existem robôs online”. Ela sugere que grande parte do que percebemos como debate público pode ser amplificado, direcionado ou até iniciado artificialmente.

E se isso for minimamente verdadeiro, a implicação é profunda: nossa percepção de consenso pode estar sendo fabricada.

O consenso como construção invisível

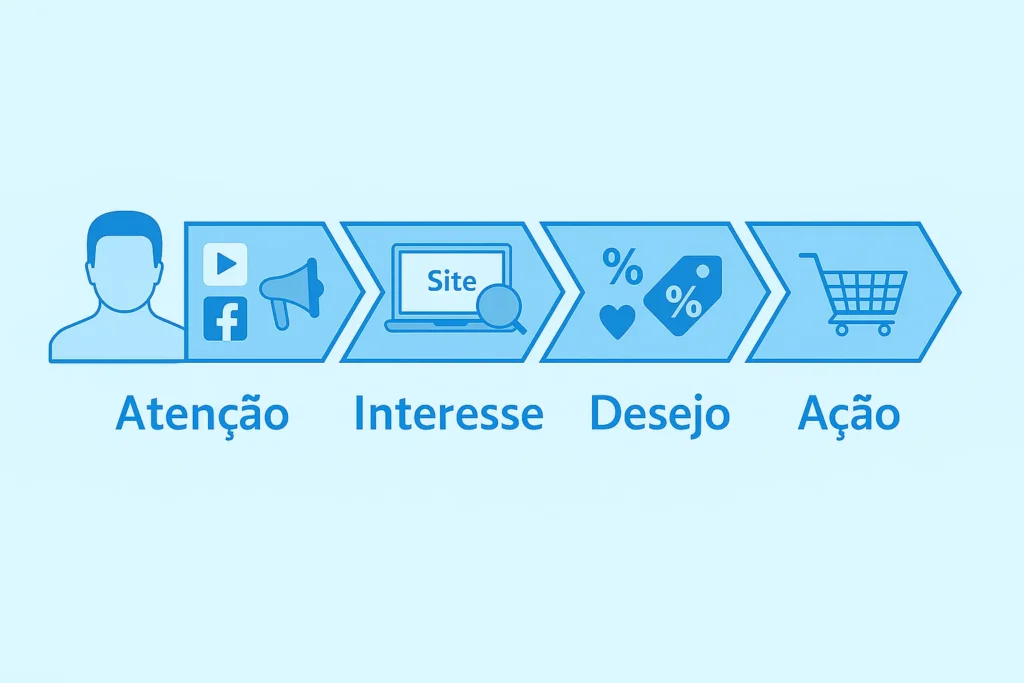

Existe um fenômeno psicológico poderoso chamado prova social. Tendemos a acreditar que algo é verdadeiro quando percebemos que muitas pessoas defendem aquilo.

Mas o que acontece quando a “multidão” pode ser parcialmente automatizada?

Se você abre uma rede social e vê milhares de comentários defendendo uma posição, sua mente registra aquilo como maioria. Como tendência. Como clima cultural.

A Dead Internet Theory questiona justamente isso: será que estamos reagindo a pessoas ou a estruturas de amplificação?

E talvez a pergunta mais incômoda seja outra: isso importa?

Algoritmos não querem verdade. Querem retenção.

A internet contemporânea não é organizada cronologicamente. Ela é organizada por incentivo. O que retém atenção sobe. O que polariza engaja. O que simplifica performa melhor do que o que complexifica.

Mesmo sem automação, esse desenho já molda comportamento. Com automação em larga escala, a distorção se intensifica.

A sensação de que o mundo está permanentemente em conflito pode ser menos reflexo da realidade e mais consequência de design.

Quem viveu a internet dos fóruns, dos blogs independentes, das comunidades nichadas, percebe a diferença. Havia mais imperfeição. Mais argumentação longa. Mais construção lenta de reputação.

Hoje, a experiência é mais rápida, mais padronizada, mais otimizada.

Quando a IA começa a treinar a própria IA

Aqui entramos na parte realmente delicada.

Modelos de linguagem são treinados com grandes volumes de dados públicos disponíveis na internet. Textos, artigos, livros, fóruns, páginas web.

Mas pesquisadores já alertaram para um risco conhecido como “model collapse”. Em 2023, um estudo publicado por pesquisadores de universidades como Oxford e Cambridge mostrou que, quando modelos passam a ser treinados com dados gerados por modelos anteriores, a qualidade estatística do aprendizado pode degradar ao longo das gerações.

O fenômeno ocorre porque modelos tendem a reproduzir padrões médios do que aprenderam. Se passam a aprender predominantemente com material sintético derivado de si mesmos, a diversidade informacional diminui. Erros sutis podem se amplificar. Nuances podem desaparecer. É uma espécie de endogamia informacional.

Se humanos criam conteúdo a partir de experiência concreta e IAs aprendem com esse conteúdo, o ciclo é rico. Mas se IAs passam a aprender majoritariamente com conteúdo produzido por outras IAs, o sistema começa a girar em circuito fechado. Assim, a internet deixa de ser um espelho da experiência humana e passa a ser um espelho do próprio algoritmo.

Baudrillard e o simulacro digital

Aqui a teoria ganha uma camada filosófica. Jean Baudrillard escreveu sobre simulacros e hiper-realidade. A ideia de que, em determinados contextos, a representação deixa de refletir o real e passa a substituí-lo.

Ou seja, é criada uma cópia da cópia da cópia e assim sucessivamente, até que o original se torna irrelevante.

Quando conteúdo gerado por IA treina novas IAs, que produzem mais conteúdo que treina outras IAs, entramos em uma lógica semelhante. A representação começa a alimentar a si mesma.

A internet deixa de refletir o mundo. Ela passa a produzir uma versão autocontida do mundo. E nós reagimos a ela como se fosse o real.

A Dúvida Existencial

Vou trazer aqui um exemplo da cultura pop.

Em Blade Runner 2049, o protagonista passa boa parte da narrativa tentando entender se as memórias que o definem são reais ou implantadas. O personagem não sabe se é humano ou se apenas carrega uma narrativa convincente o suficiente para parecer humano. E talvez esse seja um paralelo mais interessante com a internet atual do que parece à primeira vista.

Durante muito tempo, a experiência online tinha fricção. Havia erro, havia improviso, havia personalidade evidente. O texto denunciava o autor. O argumento tinha marca individual. Hoje, uma parcela crescente do conteúdo é estruturalmente impecável: coerente, organizado, informativo, otimizado.

Mas essa eficiência começa a produzir um efeito colateral curioso. Quanto mais perfeito o texto, menos evidente se torna a presença humana por trás dele. A dúvida deixa de ser “isso está certo?” e passa a ser “isso foi vivido por alguém?”.

O risco, portanto, não é que a internet seja dominada por mentiras explícitas. É que ela se torne progressivamente autorreferente. Uma camada de linguagem aprendendo com outra camada de linguagem, que aprendeu com outra camada anterior, até que a conexão com a experiência concreta se torne cada vez mais indireta.

Nesse cenário, não é necessário que a maioria absoluta do conteúdo seja artificial para que a percepção geral mude. Basta que a proporção seja alta o suficiente para alterar a textura do ambiente.

Em Blade Runner 2049, a angústia não vem da existência da máquina, mas da dúvida sobre a origem da memória. Talvez a inquietação contemporânea não venha da existência da IA, mas da dúvida sobre a origem do discurso. Quando não sabemos mais se estamos diante de uma vivência ou de uma média probabilística bem construída, algo na percepção de realidade se desloca.

O caso Natalia Beauty e o contrato implícito da escrita

A controvérsia envolvendo as colunas geradas com apoio de IA por Natalia Beauty na Folha de S.Paulo expõe uma camada importante dessa discussão. No fundo, ela revela um choque de expectativas entre dois mundos que operam sob contratos diferentes: o da cultura digital, onde ferramentas são extensões naturais do criador, e o do jornalismo tradicional, onde a assinatura carrega um peso histórico específico.

Escritores sempre utilizaram ferramentas. Revisores, editores, softwares de correção gramatical. Mas a IA generativa introduz uma diferença qualitativa: ela não apenas corrige ou organiza; ela sugere, estrutura, formula e antecipa.

Quando um colunista usa um corretor ortográfico, ninguém questiona autoria. Quando usa um modelo de linguagem capaz de propor parágrafos inteiros, a fronteira se torna menos evidente.

E isso não significa automaticamente empobrecimento. Pode haver clareza maior, organização melhor, argumentação mais coesa. O problema não é técnico. É relacional.

E talvez essa seja a pergunta que atravessa toda essa discussão sobre IA e produção textual: ainda conseguimos perceber quando estamos lendo um raciocínio vivido, e quando estamos lendo uma média probabilística sofisticada?

Aliás, nesse caso chegou-se a criar textos de “o que a ia acha do texto de ia da Natalia Beauty“, o que ilustra bem o que queremos discutir aqui.

O risco não é a mentira. É a diluição.

Talvez o maior risco não seja a desinformação explícita. Seja a perda de densidade.

Conteúdo sintético tende a buscar média. Evita idiossincrasias. Reduz fricção. Soa correto, mas raramente vivido. Com o tempo, isso pode gerar um ambiente onde tudo parece plausível, mas pouco parece profundamente humano.

Paradoxalmente, quanto mais conteúdo existe, menos singular ele parece.

A internet está morta?

Não, mas acredito que a espontaneidade esteja sob pressão. A produção de conteúdo provavelmente está se automatizando em escala exponencial. E modelos futuros podem aprender com um oceano crescente de material sintético.

O risco maior é que estejamos imersos em um ambiente progressivamente autorreferente, onde discurso gera discurso, algoritmo amplifica algoritmo e linguagem aprende com linguagem até que a origem humana se torne apenas uma camada distante do processo.

Porque, no fim, a internet continuará existindo. Máquinas continuarão produzindo texto. Algoritmos continuarão organizando o que vemos, mas em meio a esse ruído crescente, ainda saberemos reconhecer (e valorizar) quando há alguém pensando de verdade do outro lado?